Robots.txt là gì? Cấu hình sai có thể khiến Google bỏ qua website

Khi một website mất index hàng loạt, traffic giảm đột ngột, hoặc Google không hiển thị những trang quan trọng nhất – nguyên nhân rất thường gặp không nằm ở nội dung, không nằm ở backlink… mà đến từ một file nhỏ chỉ vài dòng: robots.txt.

Vấn đề là: robots.txt sai không tạo ra lỗi hiển nhiên. Nó không làm website sập. Nó không báo đỏ. Nhưng nó có thể âm thầm khiến Google bỏ qua toàn bộ website.

Với các doanh nghiệp, đặc biệt là những website mới thiết kế hoặc vừa redesign, robots.txt là một trong những yếu tố Technical SEO dễ bị xem nhẹ nhất – và cũng là thứ gây thiệt hại lớn nhất nếu cấu hình sai.

Trong bài viết này, Mimo Group sẽ giúp bạn hiểu:

- Robots.txt thực sự ảnh hưởng thế nào đến khả năng được Google index

- Những lỗi cấu hình phổ biến khiến website mất traffic

- Khi nào nên – và không nên – sử dụng robots.txt

- Cách đảm bảo website của bạn không bị Google “bỏ qua” chỉ vì một file cấu hình

Bài viết thuộc cụm Technical SEO trong hệ thống kiến thức về website chuẩn kỹ thuật. Nếu bạn chưa nắm tổng thể, nên đọc thêm:

👉 Website chuẩn Technical SEO là gì? Checklist đầy đủ 2026

Robots.txt hoạt động như thế nào trong quá trình Google crawl?

Để hiểu vì sao robots.txt quan trọng, cần nhìn nó trong toàn bộ quy trình Google xử lý website.

Crawl → Index → Rank: Robots.txt nằm ở đâu?

Google xử lý website theo 3 bước:

- Crawl (thu thập dữ liệu)

- Index (lập chỉ mục)

- Rank (xếp hạng)

Robots.txt can thiệp ngay từ bước đầu tiên: Crawl.

Nếu Googlebot bị chặn ở bước crawl, nó không thể:

- Đọc nội dung

- Hiểu cấu trúc

- Đánh giá chất lượng

- Và tất nhiên, không thể xếp hạng

Điều này khác hoàn toàn với các yếu tố như thẻ Title, Meta Description hay cấu trúc URL – vốn chỉ ảnh hưởng sau khi trang đã được crawl. ( Bạn có thể xem chi tiết hơn tại: Thẻ Title và Meta Description và Cấu trúc URL chuẩn SEO).

Robots.txt là “cánh cửa đầu vào”. Đóng sai, mọi thứ phía sau trở nên vô nghĩa.

Googlebot đọc file robots.txt như thế nào?

Khi Google truy cập một website, nó luôn tìm đến:

https://domain.com/robots.txt

Nếu file tồn tại, Google sẽ:

- Đọc các chỉ thị User-agent

- Kiểm tra dòng Disallow / Allow

- Xác định khu vực nào được phép hoặc không được phép crawl

Quan trọng:

Robots.txt không có tác dụng xóa index nếu trang đã được index trước đó. Nó chỉ ngăn crawl.

Đây là một trong những hiểu lầm phổ biến nhất khiến nhiều doanh nghiệp chặn sai toàn bộ trang quan trọng.

Những hiểu lầm phổ biến về robots.txt

- “Chặn robots.txt là trang sẽ không index” → Sai.

- “Robots.txt giúp bảo mật nội dung” → Sai.

- “Website nhỏ không cần robots.txt” → Sai.

- “Copy robots.txt của website khác là được” → Rất nguy hiểm.

Robots.txt phải được cấu hình dựa trên:

- Kiến trúc website

- Mục tiêu SEO

- Cấu trúc URL

- Hệ thống CMS

- Chiến lược nội dung

Đó là lý do trong quy trình thiết kế website chuẩn SEO, robots.txt không bao giờ là phần làm sau cùng.

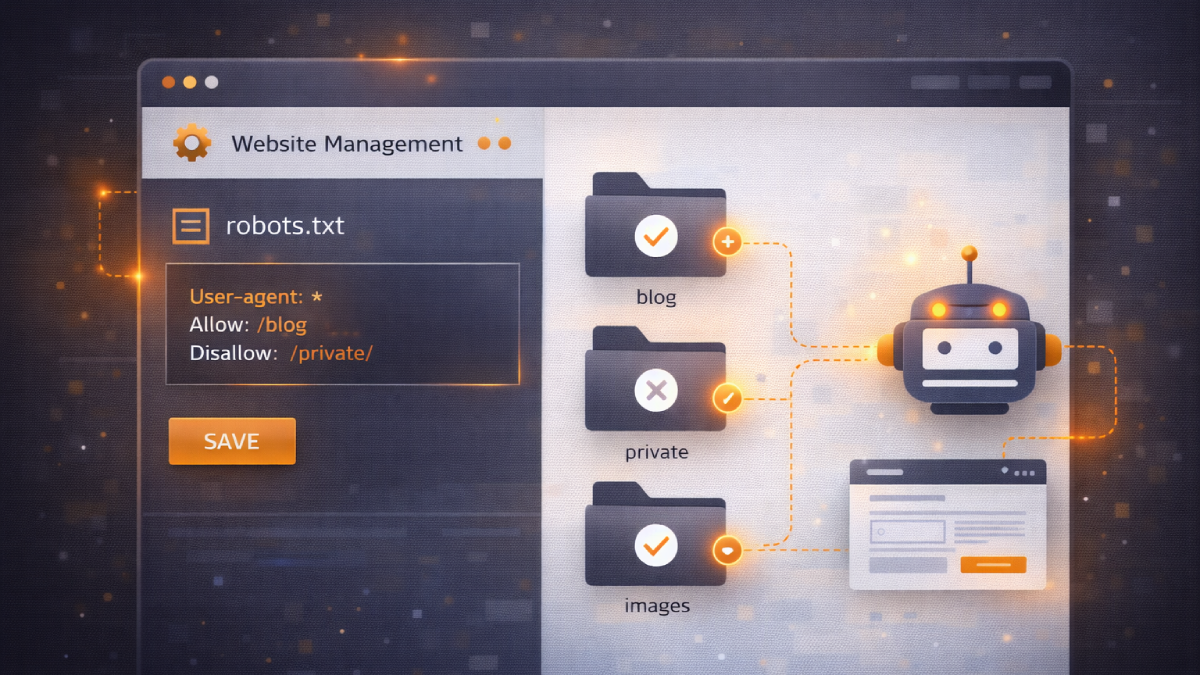

Cấu trúc chuẩn của file robots.txt

Một file robots.txt cơ bản gồm:

- User-agent

- Disallow

- Allow

- Sitemap

Nhưng cấu hình đúng lại không hề “cơ bản”.

User-agent là gì?

User-agent xác định bot nào được áp dụng quy tắc.

Ví dụ:

User-agent: *

Dấu * nghĩa là áp dụng cho tất cả bot.

Trong một số dự án lớn, có thể cấu hình riêng cho:

- Googlebot

- Bingbot

- Bot quảng cáo

Nhưng với website doanh nghiệp, cấu hình chung thường đủ.

Disallow vs Allow khác nhau thế nào?

Disallow: chặn đường dẫn.

Allow: cho phép một phần trong khu vực bị chặn.

Ví dụ sai kinh điển:

User-agent: *

Disallow: /

Chỉ một dòng này có thể khiến toàn bộ website không được crawl.

Trường hợp này thường xảy ra khi:

- Website đang ở môi trường test

- Dev quên xóa dòng chặn sau khi đưa live

Đây là lỗi rất thường gặp khi redesign website mà không có quy trình Technical SEO rõ ràng – đặc biệt ở những dự án chỉ tập trung vào giao diện.

Sử dụng Sitemap trong robots.txt

Thêm dòng:

Sitemap: https://domain.com/sitemap.xml

Giúp Google:

- Phát hiện sitemap nhanh hơn

- Tối ưu crawl

- Tăng khả năng index

Robots.txt không thay thế sitemap. Nhưng nếu thiếu sitemap, Google phải tự dò cấu trúc – mất thời gian và dễ bỏ sót.

Wildcard và ký tự đặc biệt (*, $)

Ký tự * cho phép chặn theo mẫu.

Ký tự $ dùng để chỉ kết thúc URL.

Ví dụ:

Disallow: /*?filter=

Thường dùng với website thương mại điện tử có URL lọc sản phẩm.

Nhưng nếu dùng sai, bạn có thể vô tình chặn cả trang danh mục chính.

Những lỗi cấu hình robots.txt khiến website bị Google bỏ qua

1. Chặn nhầm toàn bộ website

Lỗi:

Disallow: /

Thường xảy ra khi:

- Website test bị đẩy lên production

- Dev giữ nguyên file chặn cũ

- Không kiểm tra lại sau khi launch

Hậu quả:

- Website không được crawl

- Trang không index

- Traffic bằng 0

2. Chặn nhầm thư mục quan trọng

Ví dụ:

Disallow: /blog/

Nếu blog là khu vực nội dung SEO chính, bạn đang tự chặn nguồn traffic.

3. Chặn file CSS/JS

Google cần đọc CSS và JS để hiểu layout và nội dung hiển thị.

Nếu chặn:

Disallow: /wp-content/

Google có thể:

- Không render đúng trang

- Đánh giá sai trải nghiệm

- Ảnh hưởng xếp hạng

Điều này liên quan trực tiếp đến Technical SEO tổng thể và Core Web Vitals.

4. Không cập nhật robots.txt sau khi redesign

Một trong những lỗi phổ biến nhất.

Website thay đổi:

- Cấu trúc URL

- Thư mục

- Hệ thống CMS

Nhưng robots.txt giữ nguyên.

Hệ quả:

- Google bị chặn nhầm thư mục mới

- Sitemap không cập nhật

- Crawl budget lãng phí

Đây là lý do việc thiết kế website phải đi cùng quy trình Technical SEO chuẩn – không thể tách rời.

5. Dùng robots.txt thay cho noindex

Robots.txt không phải công cụ loại bỏ trang khỏi index.

Nếu muốn trang không xuất hiện trên Google, phải dùng:

- Thẻ meta noindex

- Hoặc header noindex

Việc nhầm lẫn giữa robots.txt và noindex là một trong 10 lỗi technical SEO phổ biến nhất khi thiết kế website mới.

Cách kiểm tra robots.txt đúng cách

1. Kiểm tra thủ công

Truy cập:

domain.com/robots.txt

Xem có dòng chặn bất thường không.

2. Google Search Console

Trong Search Console:

- Kiểm tra trạng thái index

- Xem trang bị “Blocked by robots.txt”

Nếu thấy cảnh báo này xuất hiện ở trang quan trọng → cần xử lý ngay.

3. Theo dõi log file

Với website lớn, cần theo dõi:

- Googlebot có crawl đúng khu vực không

- Có bị redirect vòng lặp

- Có crawl nhầm trang filter

Đây là phần thuộc chuyên môn Technical SEO nâng cao, thường nằm trong dịch vụ SEO tổng thể hơn là thao tác cơ bản.

Khi nào nên và không nên dùng robots.txt?

Nên dùng khi:

- Website có nhiều trang lọc

- Có khu vực admin

- Có trang tìm kiếm nội bộ

- Cần tối ưu crawl budget

Không nên dùng khi:

- Chỉ muốn ẩn trang khỏi Google

- Muốn bảo mật thông tin

- Không hiểu rõ cấu trúc website

Robots.txt là công cụ quản lý crawl – không phải công cụ bảo mật.

Robots.txt và mối liên hệ với Technical SEO tổng thể

Robots.txt không đứng riêng lẻ.

Nó liên quan trực tiếp đến:

- Crawl budget

- Indexation

- Cấu trúc URL

- Sitemap

- Core Web Vitals

- Kiến trúc website

Một file robots.txt sai có thể làm hỏng toàn bộ hệ thống SEO, dù nội dung và backlink rất tốt.

Vì vậy trong mô hình triển khai của Mimo:

- Technical SEO được thiết kế từ đầu

- Robots.txt không phải bước “sửa lỗi”

- Mà là thành phần của kiến trúc website

Bạn có thể xem đầy đủ checklist tại:

👉 Website chuẩn Technical SEO là gì? Checklist đầy đủ 2026

Checklist cấu hình robots.txt chuẩn 2026

Dưới đây là checklist dành cho doanh nghiệp khi nghiệm thu website:

- Không có dòng Disallow: /

- Không chặn thư mục nội dung chính

- Không chặn CSS/JS cần thiết

- Có khai báo sitemap

- Kiểm tra lại sau khi redesign

- Kiểm tra bằng Search Console

- Đảm bảo không dùng robots.txt thay cho noindex

Nếu website của bạn chưa từng được kiểm tra robots.txt sau khi thiết kế hoặc nâng cấp, khả năng cao đang tồn tại rủi ro ẩn.

Robots.txt và vai trò trong thiết kế website chuẩn SEO

Rất nhiều doanh nghiệp nghĩ rằng SEO chỉ bắt đầu sau khi website hoàn thành.

Thực tế:

SEO kỹ thuật bắt đầu từ lúc thiết kế cấu trúc.

Robots.txt là một phần của:

- Kiến trúc website

- Hệ thống điều hướng

- Phân tầng nội dung

- Quản lý crawl

Nếu thiết kế web mà không có tư duy SEO kỹ thuật, bạn đang tự tạo rào cản cho Google.

Đó là lý do Mimo không xây dựng website theo kiểu “xong giao diện rồi mới tính SEO”.

SEO kỹ thuật là nền tảng.

Kết luận: Đừng để một file 5 dòng làm mất toàn bộ traffic

Robots.txt không phải yếu tố phức tạp.

Nhưng nó là yếu tố có sức ảnh hưởng lớn.

Một sai sót nhỏ có thể:

- Khiến Google không crawl

- Làm mất index

- Giảm traffic

- Ảnh hưởng doanh thu

Nếu website của bạn:

- Vừa thiết kế lại

- Đang mất index bất thường

- Không tăng trưởng traffic dù nội dung tốt

Thì robots.txt là một trong những điểm cần kiểm tra đầu tiên.

Nếu bạn muốn xây dựng website ngay từ đầu theo chuẩn Technical SEO – đảm bảo không mắc các lỗi nền tảng như robots.txt, cấu trúc URL, indexation – bạn có thể tham khảo dịch vụ:

Vì SEO không bắt đầu từ nội dung.

SEO bắt đầu từ kiến trúc.Và robots.txt chính là cánh cửa đầu tiên của kiến trúc đó.

Mimo Group Chuyên SEO, thiết kế website và marketing online cho doanh nghiệp.